8 Minutės

Google naujoji Ironwood TPU šeima vėl pakurstė ilgą laiką verdančią kovą dėl dirbtinio intelekto aparatūros: šįsyk tikroji Nvidia varžovė nėra AMD ar Intel, o pačios Google specializuota silicio architektūra, optimizuota inferencijai. Dėl įspūdingo atminties talpumo, tankių tarpusavio jungčių ir ambicingų efektyvumo pareiškimų Ironwood keičia, kaip skalėje atrodo debesų AI paslaugos.

Ironwood skaičiais: atmintis, skaičiavimo galia ir skalėjanti SuperPod

Pagrinde Ironwood (TPU v7) sukurtas vienam tikslui – modelių aptarnavimui produkcijoje. Google jį pozicionuoja kaip „inference-first“ lustą su specifikacijomis, kurios sumažina uždelsimą, sumažina energijos sąnaudas vienam užklausos vienetui ir supaprastina didelių kalbinių modelių bei kitų realaus laiko AI paslaugų diegimą.

- Piko FP8 skaičiavimas vienam lustui: ~4,614 TFLOPs

- Ant pakuotės esanti atmintis: 192 GB HBM3e (apytiksliai 7–7.4 TB/s pralaidumas)

- Pod skalė: iki 9,216 lustų viename SuperPod

- Bendras skaičiavimas poode: ≈42.5 exaFLOPS (FP8)

- Sistemos HBM poode: ~1.77 PB

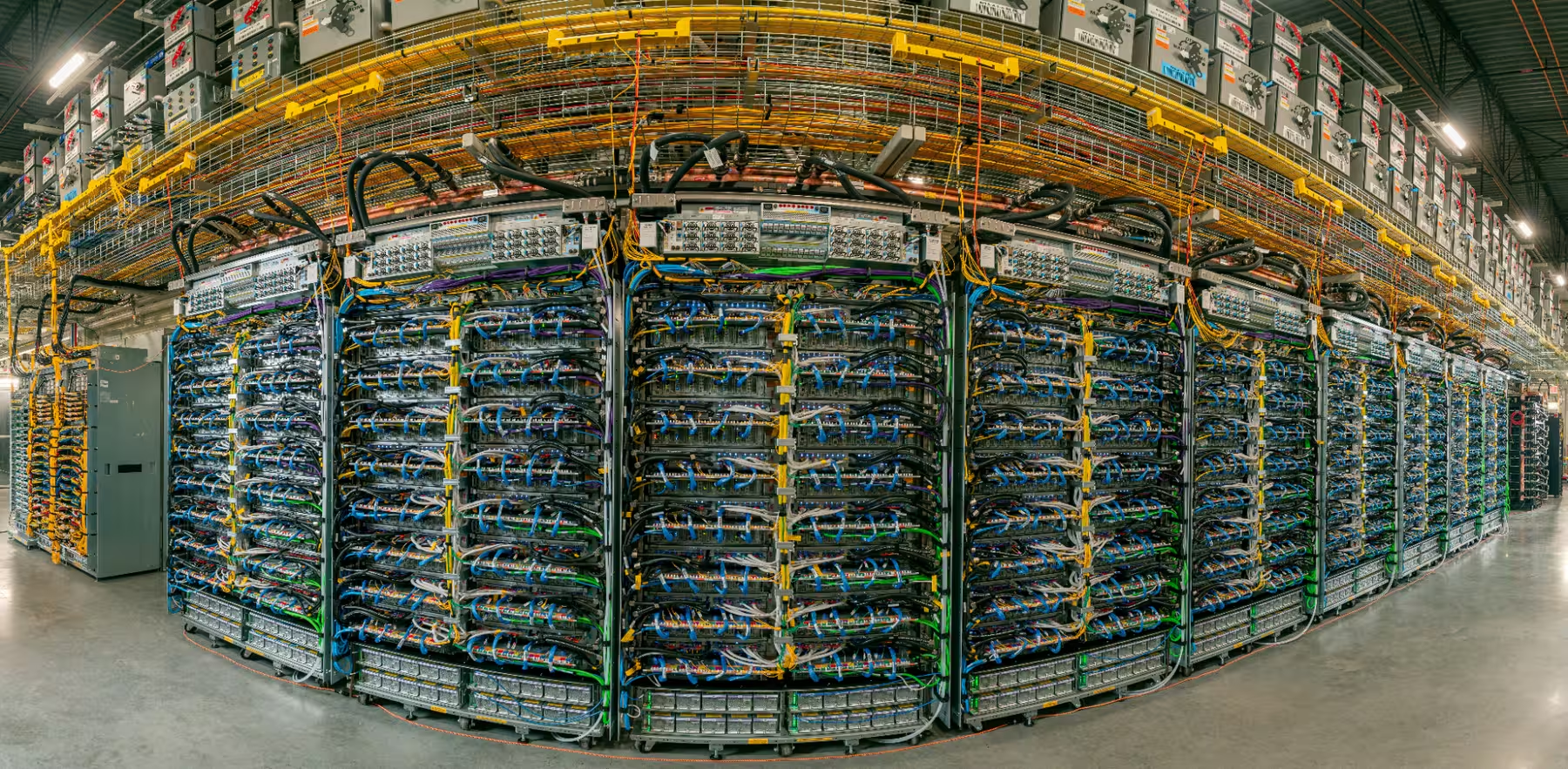

Šie grynieji skaičiai yra svarbūs, tačiau istorija taip pat apie tai, kaip lustai tarpusavyje komunikuoja. Google naudoja InterChip Interconnect (ICI) ir 3D torus išdėstymą, kad sujungtų daugybę lustų į vientisą SuperPod, pasikliaudama scale-up fabriku ir 1.8 PB tarp‑pod tinklu, kuris leidžia dideliems modeliams likti greitoje atmintyje, o ne nuolat perkelti svorius per lėtesnes nuorodas. Tokia architektūra sumažina tinklo latenciją ir duomenų perkėlimo kaštus, kas yra kritiškai svarbu didelio masto inference užduotims.

Techniniu požiūriu, ant pakuotės esanti HBM3e atmintis ir padidintas pralaidumas leidžia laikyti plačias modelių dalis ar net pilnas svorių kopijas arčiausiai skaičiavimo elementų. Tai reiškia mažesnį poreikį dėl tarplustinių transakcijų ir didesnį užklausų pralaidumą. Be to, didelis skaičiavimo intensyvumas FP8 režime rodo, kad Google optimizavo architektūrą tiek skaičiavimo tankiui, tiek energijos efektyvumui, o tai turi tiesioginį poveikį kainai už inference užklausą debesų aplinkoje.

Dėl tokio derinio — aukšto TFLOPs, didelės HBM talpos ir specializuotos komunikacijos topologijos — Ironwood labiau orientuotas į nuolatinę per sekundę gaunamų užklausų aptarnavimo apkrovą nei vien tik į mokymo etapo spartą. Tokia strategija atitinka rinkos pokyčius, kur didelė dalis debesų išlaidų kyla iš ilgalaikio inference kaštų.

Kodėl inferencija pakeičia konkurencinę žemėlapį

Anksčiau mokymas buvo pagrindinė kovos arena: grynieji TFLOPs, didelės atminties talpos ir optimizuoti branduoliai buvo svarbiausi rodikliai, ir Nvidia GPU dominavo šioje srityje. Tačiau AI ekonomika keičiasi. Kartą apmokyti modeliai generuoja milijardus inferencijos užklausų — ne mokymo sesijos tampa tikruoju darbo krūviu. Tai reiškia, kad prioritetu tampo uždelsimas (latencija), užklausų srautas (throughput), energija vienai užklausai ir kaštų efektyvumas.

.avif)

Ironwood yra kuriamas atsižvelgiant į šiuos rodiklius. Didelė ant pakuotės esanti atmintis sumažina tarp lustų vykstančias komunikacijas dideliems modeliams, o tai mažina uždelsimą. Google teigia, kad Ironwood suteikia reikšmingą kartos atžvilgiu patobulintą našumą ir energijos efektyvumą (bendrovė teigia apie ~2× energijos efektyvumo pagerėjimą, palyginti su ankstesnėmis TPU kartomis). Hyperscaleriai ir debesų klientai, kurie moka už 24/7 inferencijos talpą, gali paversti tą efektyvumą tiesioginėmis kaštų taupymo priemonėmis.

Praktiškai tai reiškia, kad klientai, vykdantys dideles produkcines paslaugas — pvz., pokalbių modelius, realaus laiko rekomendacijas, vaizdo interpretaciją ar kitas užklausų intensyvias sistemas — gali sumažinti debesų sąskaitas už energiją ir tinklą, jei perkelia aptarnavimą ant architektūros, kuri mažina duomenų judėjimą ir optimizuoja energiją vienai užklausai. Be to, geresnis energijos efektyvumas taip pat reiškia mažesnę infrastruktūros šildymo ir aušinimo naštą duomenų centruose, ką verta vertinti didelio masto diegimuose.

Inferencijos ekonomika taip pat skatina naujus operacijų modelius: prenumeratos už realaus laiko AI paslaugas, sąnaudomis pagrįstos kainodaros modeliai ir specializuoti SLA, orientuoti į latenciją. Tokiu atveju architektūra, kuri leidžia efektyviai aptarnauti milijonus užklausų per sekundę, įgyja didesnę vertę nei architektūra, kuri vien tik deklaruoja piko TFLOPs be realių inferencijos optimizacijų.

Interconnect, SuperPod'ai ir ekosistemos įrakinto aukštumas

Kitas konkurencinis pranašumas — integracija. Pateikdama Ironwood per Google Cloud, Google gali optimizuoti visą stulpelį — nuo įrangos iki tinklo ir vykdymo aplinkos (runtime) — kad sumažintų kainą už užklausą. Jos SuperPod požiūris, su tankiomis interconnect jungtimis ir scale-up fabriku, sukurtas aptarnauti labai didelius modelius su mažesnėmis našumo nuostolėmis nei fragmentuota GPU klasterių architektūra.

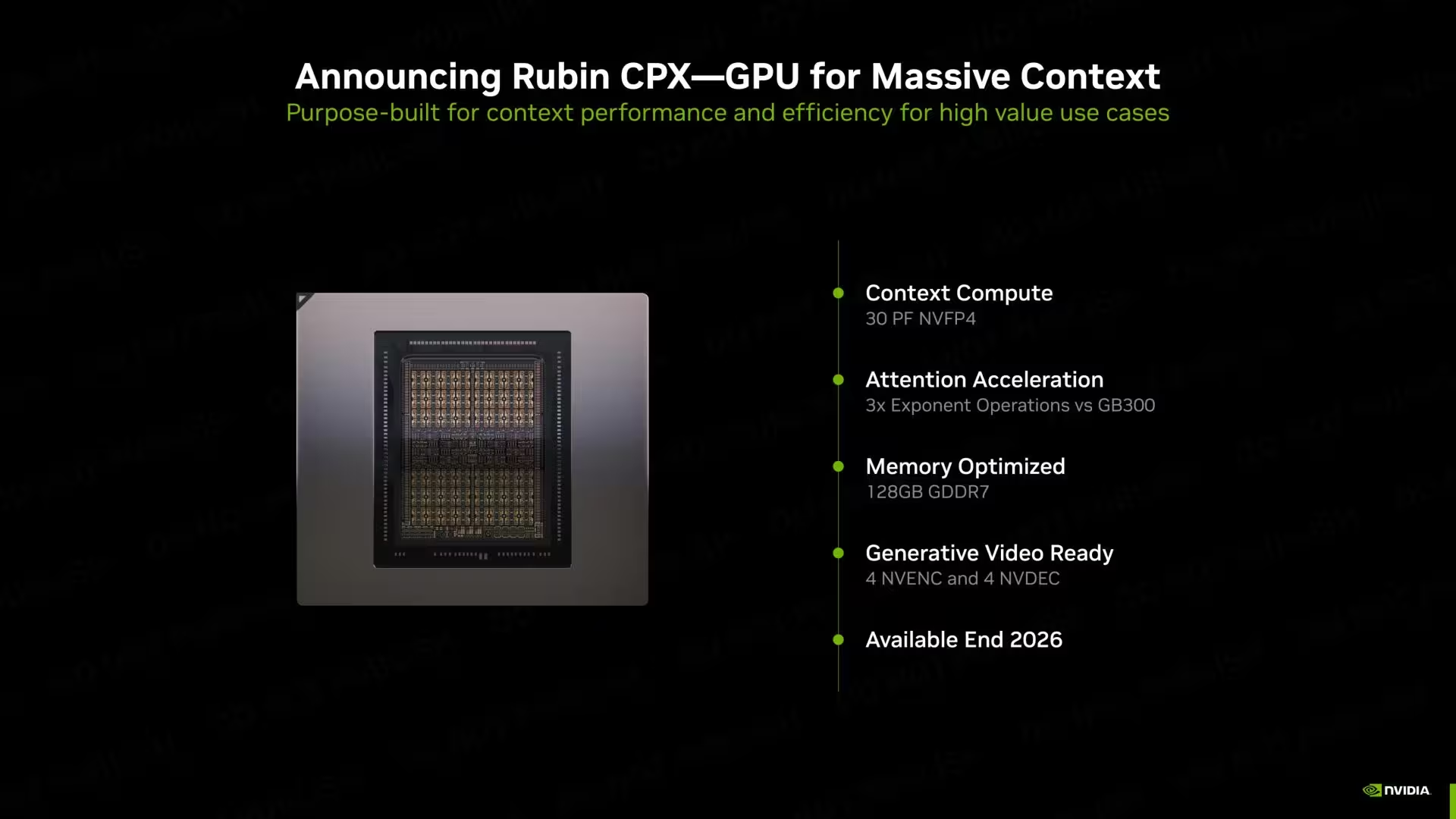

Tokia vertikali integracija gali sukurti strateginius iššūkius Nvidia pozicijai. Net ir turėdami specializuotus sprendimus, tokius kaip Nvidia Rubin stendai ir B200 Blackwell GPU, skirtus inferencijai, debesų klientai gali rinktis natyvią TPU infrastruktūrą, jei ji pastebimai sumažina uždelsimą ir eksploatacines sąnaudas. Tai reiškia, kad klientai gali labiau įsirišti (vendor lock-in) prie konkretaus debesų paslaugų teikėjo aparatūros architektūros.

Ekosistemos uždara integracija taip pat reiškia, kad Google gali pasiūlyti papildomų optimizacijų: tinklo prioritetizavimą, greituosius atminties keitimus, specializuotus runtime optimizavimus (pvz., kompiliavimo įrankius, įrankius mažinantiems quantizaciją) ir platforminius servisus, kurie supaprastina didelių modelių diegimą. Visa tai gali sąlygoti, kad organizacijos, kurioms svarbus latencija ir kainos efektyvumas inferencijai, pirmenybę teiktų vienam debesų teikėjui arba bent jau svarstytų hibridinius sprendimus, perkeliančius inferenciją prie to teikėjo infrastruktūros.

Be to, tokia integracija gali pagreitinti plėtrą aplink konkrečią programinę įrangą ir biblioteka: optimizuoti grafai, operatorių bibliotekos ir infrastruktūros įrankiai, skirti TPU inferencijai. Tai dar labiau apsunkintų multiplatforminį palaikymą ir padidintų integracijos kliūtis tarp skirtingų aparatūros tiekėjų.

Jensen Huang tai pastebėjo

Nvidia generalinis direktorius viešai pripažino, kaip sudėtinga kurti specializuotus ASIC sprendimus, ir paminėjo TPUs kaip reikšmingą konkurentą. Tokia pripažinimo forma yra svarbi: kai dominuojantis rinkos dalyvis viešai identifikuoja konkurencingą technologiją kaip grėsmę, tai dažnai signalizuoja didesnes investicijas abiejose pusėse ir spartesnę produktų evoliuciją.

Tokia dinamika gali paskatinti Nvidia intensyviau plėtoti savo programinę ekosistemą, optimizuoti inference keliuose formatuose (pvz., TensorRT, DLSS stiliaus akceleracija), ir investuoti į naujas aparatinės įrangos kartas ar specializuotus varikliukus, kurie mažina latenciją ir energijos sąnaudas. Kita vertus, Google tikėtina paspartins savo investicijas į TPU šeimą, tinklo infrastruktūrą bei debesų paslaugas, kad užtikrintų konkurencingumą tiek kainos, tiek latencijos prasme.

Tai reiškia, kad Nvidia pasmerktas žlugti?

Visai ne — tačiau taisyklės keičiasi. Nvidia vis dar pirmauja universalaus GPU skaičiavimo srityje, turi didžiulę programinės įrangos ekosistemą ir plačią rinkos pritaikymą mokymui ir daugeliui inferencijos scenarijų. Ironwood atveria naują konkurencijos ašį, sutelktą į inferencijos ekonomiką. Įmonėms, vykdančioms masinius realaus laiko diegimus, Google TPU strategija gali tapti lemiamu faktoriu.

Trumpai tariant: AI rungtynės evoliucionuoja nuo „kas turi daugiausiai flops“ į „kas aptarnauja daugiausiai užklausų pigiausiai ir greičiausiai“. Su Ironwood, įvedamu į gamybą ir debesų paslaugas, tikėtina, kad debesų tiekėjai, hyperscaleriai ir įmonės peržiūrės, kur jiems verta vykdyti inference darbo krūvius — o tai Google daro įdomiu ir rimtu iššūkiu NVIDIA ir kitiems rinkos žaidėjams.

Be to, verta pažymėti, kad konkurencija tarp specializuotos aparatūros (TPU) ir programiškai galingų GPU sprendimų skatina inovacijas tiek aparatinėje, tiek programinėje įrangoje. Tai iš esmės gerai visai pramonei: didesnis efektyvumas, mažesnės sąnaudos ir platesnės galimybės integruoti pažangias modelių versijas realiu laiku. Rinkos dalyviai turėtų atidžiai stebėti tiek techninius rodiklius (latencija, pralaidumas, energijos sąnaudos), tiek operacinius aspektus (integracijos kaštai, ekosistemos palaikymas ir suderinamumas), priimdami sprendimus dėl debesų infrastruktūros ir AI strategijos.

Galiausiai, architektūros pasirinkimas priklausys nuo konkrečių poreikių: ar prioriteto reikalas — treniravimas ir eksperimentavimas (kur GPU vis dar labai stiprūs), ar 24/7 inferencijos aptarnavimas didelėmis apimtimis (kur specializuota TPU infrastruktūra gali būti ekonomiškesnė). Įmonėms rekomenduotina įvertinti TCO (bendrą nuosavybės kaštą), SLA reikalavimus, latencijos ribas ir integracijos sudėtingumą prieš pasirenkant platformą.

Santrauka: Ironwood žymi reikšmingą žingsnį į priekį specializuotų inferencijos įrenginių srityje ir gali keisti debesų AI tiekėjų konkurencinį peizažą. Stebėkite Google Cloud, SuperPod architektūras, HBM3e atminties sprendimus ir tarp‑pod tinklų evoliuciją, kad suprastumėte, kaip keisis inferencijos privalumai ir kaštai didelio masto diegimuose.

Šaltinis: wccftech

Komentarai

duombyte

Ar čia tikrai 2× efektyvumas realybėje? skamba per gerai, hyperscaleriai gal gali išspaust — bet smulkios įmonės? bibliotekos, toolchain, palaikymas..?

Tomas

wow, netikėta! Ironwood atrodo kaip tikras žaidimų keitiklis, HBM3e ir SuperPod'ai + milžiniški TFLOPs. Bet ar praktiškai taip gerai? migracija, kainos, vendor lock in... nežinau, įdomu

Palikite komentarą