3 Minutės

Meta pradeda pasaulinį dirbtinio intelekto valdomo balso dublavimo diegimą

Meta ėmėsi visuotinio savo dirbtinio intelekto pagrindu veikiančio balso dublavimo įrankio Reels platformoje diegimo. Pirmą sykį idėja buvo užsiminta Marko Zuckerbergo pristatyme Meta Connect 2024 — sprendimas panaudoja generatyvinį DI, kad sukurtų kūrėjo kalbėto garso vertimą į kitą kalbą ir, jei pageidaujama, pritaikytų sinchronizuotą lūpų judesių seką prie išversto garso takelio.

Pagrindinės produkto savybės

Vertimas ir balso klonavimas

Funkcija adaptuoja modelį prie jūsų pradinio balso ir generuoja išverstą garso takelį, kuris išsaugo kalbėjimo toną bei ritmą. Paleidimo metu vertimai galimi tik tarp anglų ir ispanų kalbų (abiem kryptimis), o kompanija žada pridėti daugiau kalbų ateinančiais atnaujinimais.

Lūpų sinchronizavimas ir peržiūros valdikliai

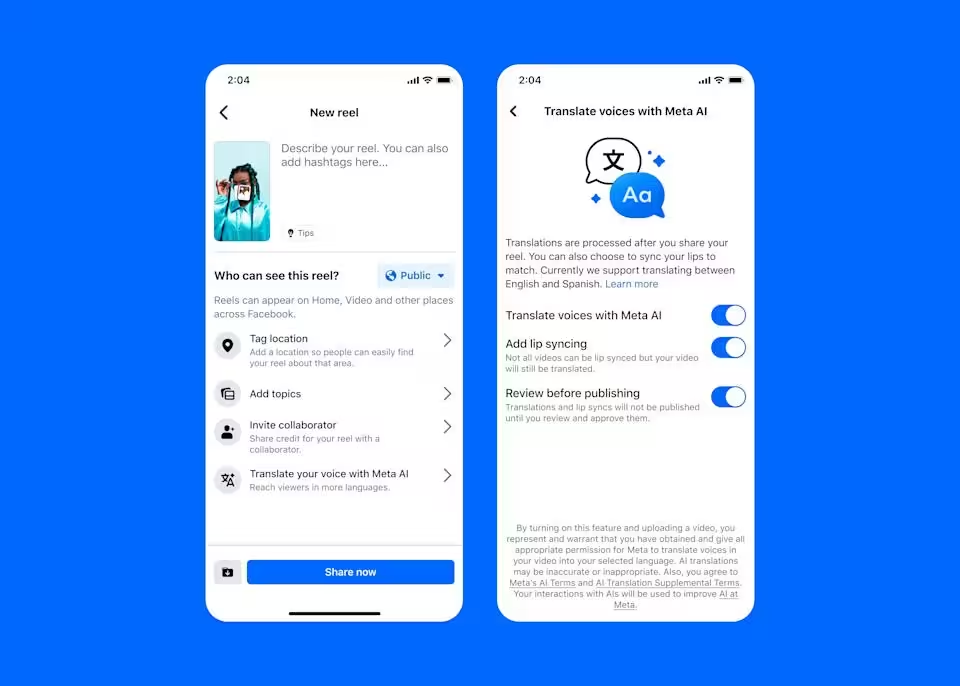

Kūrėjai gali įjungti arba išjungti lūpų sinchronizavimą ir peržiūrėti DI sugeneruotą vertimą prieš jį publikuodami. Galima pasirinkti, ar pridėti lūpų sinchronizavimą, ir iš anksto peržiūrėti rezultatą prieš skelbiant. (Meta)

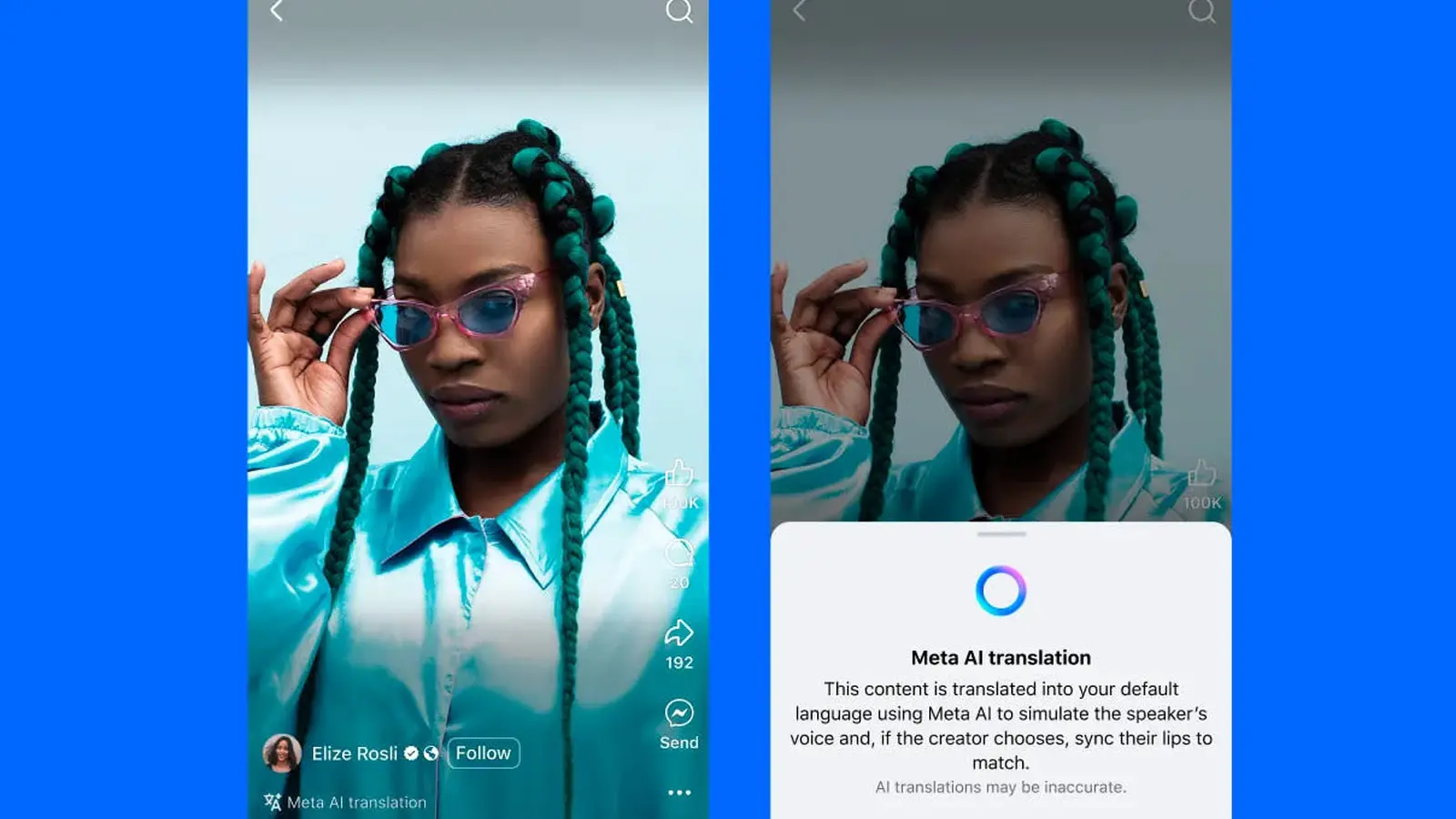

Prieiga ir kūrėjų tinkamumas

Pradiniu etapu šis įrankis skirtas Facebook kūrėjams, turintiems daugiau nei 1 000 sekėjų, tačiau bet kuris vartotojas su vieša Instagram paskyra gali juo pasinaudoti. Norėdami pritaikyti funkciją, publikuodami Reel pasirinkite parinktį "Išversti savo balsą su Meta AI" — tame meniu taip pat yra lūpų sinchronizavimo perjungiklis ir peržiūros / patikrinimo opcija. Žiūrovams bus aiškiai rodomas iššokantis pranešimas, paženklinantis klipą kaip DI vertimą.

Geriausios praktikos ir techninės rekomendacijos

Meta rekomenduoja filmuoti veidą nukreiptą į kamerą, kad pasiektumėte geriausius rezultatus. Venkite dengti burną ir mažinkite foninės muzikos lygį. Sistema palaiko iki dviejų kalbėtojų, tačiau geriausiai veikia, kai jų kalba nesikerta. Šie apribojimai padeda generatyviniam DI išlaikyti tikslumą ir natūralumą tiek išverstuose garso takeliuose, tiek vizualinėje sinchronizacijoje.

Kodėl tai svarbu — privalumai ir rinkos reikšmė

Kūrėjams ir prekės ženklams realaus laiko balso vertimas bei lūpų sinchronizacija sumažina kliūtis pasiekti daugiakalbes auditorijas, pagerina turinio lokalizaciją ir atrandamumą. Meta taip pat pridėjo kalbų pagal veikimo stebėseną, leidžiančią kūrėjams sekti įsitraukimą ir konversijas skirtingose vertimuose — tai vertingas analizės įrankis augant tarptautinei strategijai ir turinio planavimui.

Palyginimai ir konkurencinė aplinka

Meta žingsnis neatsilieka nuo kitų didžiųjų žaidėjų: YouTube pernai pristatė balso vertimo funkcijas, o Apple integravo tiesioginį vertimą į Messages, Phone ir FaceTime su iOS 16/17/18 (iOS 26 paminėjimas atspindi platesnę industrijos tendenciją). Meta išsiskiria tuo, kad vienu metu orientuojasi į balso klonavimą, generatyvinį DI vertimą ir pasirenkamą lūpų sinchronizaciją, ypač pritaikytą trumpiems Reels vaizdo įrašams.

Naudojimo scenarijai

- Influenceriams, plečiantiems auditoriją į ispanų/anglų kalbų rinkas.

- Prekės ženklams, greitai lokalizuojantiems kampanijų vaizdo įrašus be papildomų filmavimų.

- Pedagogams ir mažiems leidėjams, pritaikantiems trumpas pamokas naujoms auditorijoms.

Ateities perspektyvos

Plėtojant kalbų palaikymą ir tobulinant kalbėtojų aptarnavimą, ši funkcija gali tapti standartiniu įrankiu tarptautinei turinio lokalizacijai ir socialinių vaizdo įrašų SEO. Kol kas kūrėjams rekomenduojama eksperimentuoti su švariu garsu ir tiesiai į kamerą nukreiptais kadrais, kad pasiektų geriausią rezultatą.

Šaltinis: engadget

Palikite komentarą