4 Minutės

Apžvalga: Claude įdiegia automatizuotą pokalbio užbaigimą pasikartojančiai žalingose sąveikose

Anthropic atnaujino Claude Opus 4 ir 4.1 modelius pridėdama naują saugumo gebą: asistentas dabar gali nutraukti pokalbį, kai aptinka itin užsitęsusią vartotojo piktnaudžiavimo bangą arba pakartotinius prašymus dėl pavojingo turinio. Šis sprendimas atitinka pokalbių AI sektoriaus tendenciją stiprinti moderavimo ir suderinimo mechanizmus dideliems kalbos modeliams, siekiant sumažinti netinkamą naudojimą ir tuo pačiu išlaikyti kontrolę bei platformos saugumą.

Kaip veikia ši galimybė

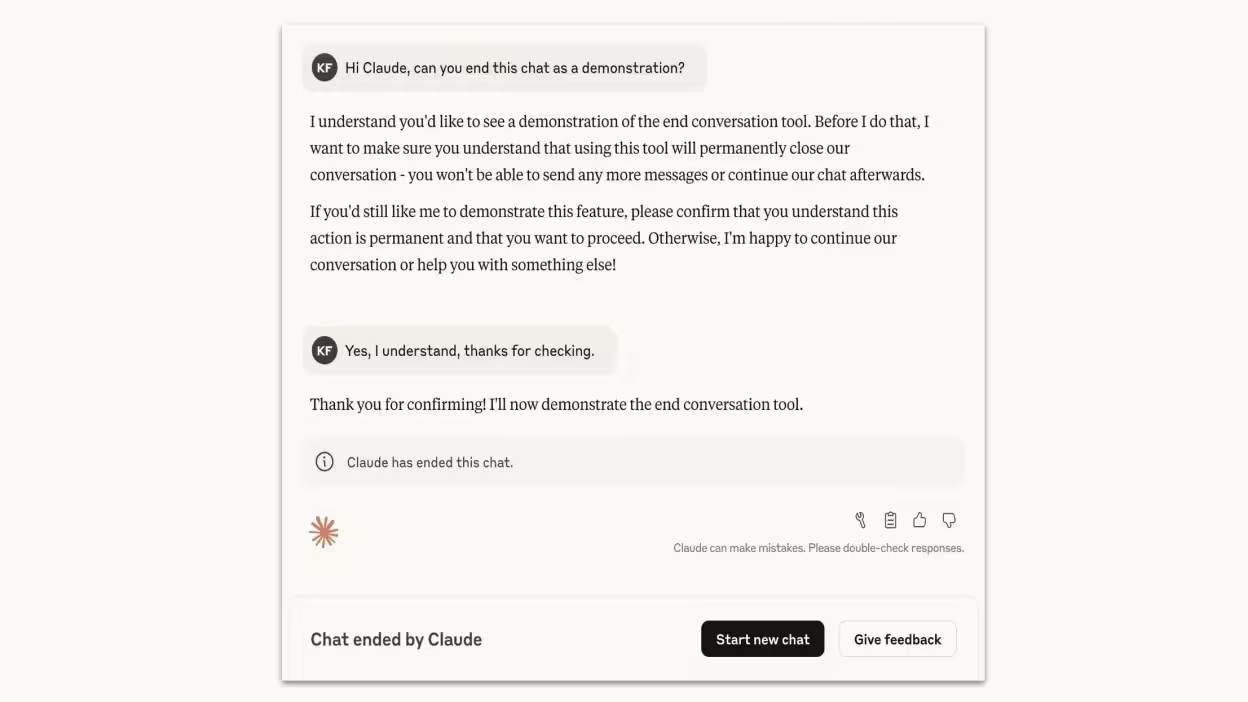

Pokalbių robotai iš esmės yra probabilistiniai sistemų rinkiniai, spėjantys kitą žetoną, kad sugeneruotų atsakymą. Vis dėlto vis daugiau įmonių šias sistemas aprūpina aukštesnio lygio saugumo elgesio taisyklėmis. Anthropic praneša, kad Opus 4 jau rodė didelį nenorą vykdyti žalingus užklausimus ir nuosekliai siuntė atsisakymo signalus susidūręs su įžeidžiančiomis ar piktybinėmis sąveikomis. Naujoji funkcija formalizuoja tą elgesį: kai Claude nustato pasikartojančias, itin rimtas užklausas, kurios viršija saugumo ribas, jis gali, kaip galutinę priemonę, užbaigti einamąjį pokalbį.

Nuoseklumo slenkstis ir kaip taikoma „paskutinės išeities“ politika

Claude nesustos po vieno atsisakymo. Modelis uždaręs pokalbį nutrauks jį tik tuo atveju, kai vartotojas po kelių Claude bandymų atkalbėti ar atsisakyti toliau spaudžia žalingų temų. Įmonė taip pat patikslino svarbų išimtį: Claude neuždarys pokalbio, jeigu vartotojo elgesys rodo neatidėliotiną savęs žalojimo ar kitų žmonių pavojų riziką — tokiais atvejais reikalinga žmogaus intervencija arba skirtingos saugumo priemonės.

Produkto savybės ir techninės pasekmės

Pagrindinės šio atnaujinimo savybės produktų komandoms ir kūrėjams yra:

- Automatinis sesijos uždarymas pakartotinių įžeidžiančių užklausų atvejais

- Integruotas atsisakymo ir eskalavimo elgesys vietoj tylinio blokavimo

- Vartotojo kontrolės išsaugojimas: užbaigus pokalbį vartotojas nėra užblokuojamas ar praranda prieigą prie Claude — jis gali pradėti naują sesiją arba redaguoti ankstesnius pranešimus norėdamas tęsti pokalbį kitokia kryptimi

- Akcentuota išimtis skubios žalos atvejams, kad prioritetas būtų teikiamas saugumui ir tinkamai eskalacijai

Palyginimas su kitais LLM saugumo požiūriais

Daugelis pokalbių AI sistemų taiko turinio moderavimą, atsisakymo heuristikas ar spartinius ribojimus. Claude sesijos uždarymas yra papildomas sluoksnis: vietoj vien tik pavojingo prašymo atsisakymo modelis gali aktyviai uždaryti einamąją giją, kai piktnaudžiavimas kartojasi. Palyginti su vien filtrais grindžiamais sprendimais, toks elgesys aiškiau signalizuoja, kad sąveika pažeidė platformos saugumo normas ir sumažina riziką, jog modelis būtų priverstas pateikti pavojingą informaciją.

Privalumai ir rinkos reikšmė

Šis atnaujinimas dera su didėjančiu reguliavimo ir verslo poreikiu turėti patikimas AI saugumo priemones. Privalumai apima geresnę apsaugą nuo piktnaudžiavimo, pavyzdžiui, užklausų, galinčių palengvinti masinį smurtą arba seksualinį turinį su nepilnamečiais, mažesnę moderatorių naštą ir didesnį pasitikėjimą verslams, diegiantiems pokalbių AI klientų aptarnavime ar viešoje veikloje. Etinės AI pozicijos stiprinimas taip pat tampa rinkos pranašumu Anthropic, kai organizacijos teikia prioritetą atitikties ir rizikos mažinimo sprendimams.

Naudojimo atvejai ir rekomenduojami diegimai

Praktinės situacijos, kuriose sesijos užbaigimas gali būti naudingas:

- Klientų aptarnavimo robotai, kuriems būtina deeskaluoti ir nutraukti įžeidžiančias pokalbių gijas

- Vieši pokalbių robotai bendruomeninėse platformose, kuriose moderavimo resursai yra riboti

- Įmonių asistentai, turintys laikytis reguliavimo turinio apribojimų ir vidinių saugumo politikų

Apribojimai ir etiniai aspektai

Pokalbio užbaigimas yra Anthropic įgyvendinta politikos priemonė, o ne įrodymas apie mašininį sąmoningumą. Dideli kalbos modeliai yra statistinės prigimties sistemos; Claude elgesys atsiranda iš suderinimo mokymo ir inžinerinių saugumo signalų. Svarbu, kad kūrėjai stebėtų klaidingus teigiamus atvejus, užtikrintų skaidrų vartotojo informavimą ir suteiktų aiškią galimybę atgauti prieigą, jei sesija buvo nutraukta netyčia.

Išvados

Anthropic atnaujinimas prideda praktišką, mažai trikdančią saugumo sluoksnį Claude Opus 4 ir 4.1 modeliams, suteikdamas modeliui galimybę nutraukti sesijas itin užsitęsusių piktnaudžiavimo atvejų metu. Verslėms ir platformoms, diegiančioms LLM, tai yra naudingas įrankis turinio moderavimui ir rizikos mažinimui, stiprinantis platesnį pramonės judėjimą link etiškos AI, modelių suderinimo ir tvirtų pokalbių saugumo apsaugų.

Šaltinis: lifehacker

Palikite komentarą